钱盾App发布中国反诈报告:诈骗电话来自71个国家和地区

“2017年上半年,来自中国大陆以外的诈骗电话量已经翻倍,诈骗电话来自71个国家和地区,诈骗短信量已经占到整体的近5%,通讯网络诈骗的国际化趋势愈发明显。”7月27日,国家会议中心,国务院联席办钱盾反诈平台专家沈杰在2017网络安全生态峰会上公布了如上数字。

在本次峰会的新安全赋能平安中国分论坛,12321网络不良与垃圾信息举报受理中心主任郝智超,山东交通广播副总监智勇,蚂蚁金服集团安全管理部总监祝志晓等发表讲话。

12321网络不良与垃圾信息举报受理中心主任郝智超

山东交通广播副总监智勇

钱盾App发布了《2017年中国反通讯网络诈骗报告(上半年)》。数据显示,随着打击力度持续增强,通讯网络诈骗有向国际“发展”的趋势,呈现出全球化特点,犯罪分子跨境作案,空间跨度大,追查线索难,给破案追赃带来很大困难。为了保护用户资金不被骗,钱盾App专门推出了非中国大陆电话提醒功能。

钱盾反诈平台专家沈杰正在解读《2017上半年中国反通讯网络诈骗报告》

一条海外兼职刷单短信骗走4356元

2017年7月17日,浙江省浦江县的刘飞收到一条号码为“0066830034***”的短信,显示地区是泰国,短信内容称,刘飞信用良好,邀请其从事兼职刷单赚钱,之后,骗子让刘飞加了一个QQ号码,刘飞填过一张含名字、职业、年龄、支付方式和账号等信息的表格后,骗子让其通过一个新手任务,这一次,刘飞挣到了5元佣金。

而后,骗子要求刘飞拍下13个手提包,一共花了4356元,支付完成之后,对方要求他再次购买,但并没有任何返还垫付款,这时,刘飞意识到自己被骗了。

像刘飞一样,遭遇跨国短信诈骗的案例越来越多。

据《2017年中国反通讯网络诈骗报告(上半年)》数据显示,随着国内手机实名制等制度的完善,诈骗短信的国际化趋势非常明显。上半年,钱盾App拦截到的诈骗短信中,有接近5%来自中国大陆以外,其中大部分来自于东南亚及中国香港、澳门地区。马来西亚是除中国大陆以外的第一大诈骗短信来源地,数量多,增长明显。

诈骗短信量来源地TOP5

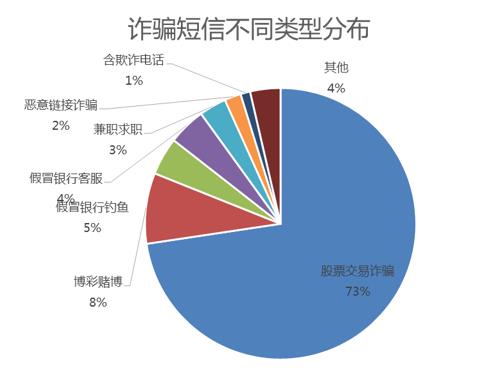

此外,据报告数据显示,2017年上半年的诈骗短信内容中,股票交易诈骗占73%,8%为赌博欺诈,假冒银行钓鱼和客服诈骗也较多,分别占到了5%和4%,之后便是兼职求职的诈骗短信。

诈骗短信的内容分布

上半年,诈骗电话来自71个国家和地区

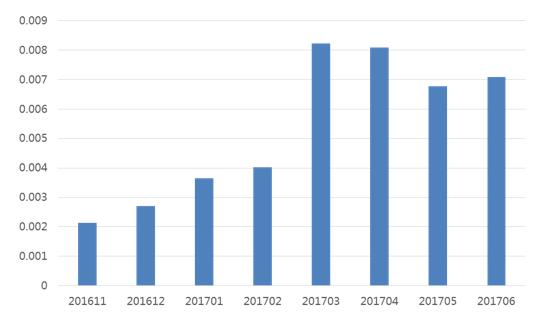

根据钱盾《2017年中国反通讯网络诈骗(上半年)》报告显示,钱盾为用户拦截的中国大陆以外诈骗电话占诈骗电话总体比例也出现了明显上升,半年上涨了近100%。

图5 2017年上半年中国大陆以外地区诈骗电话占比趋势

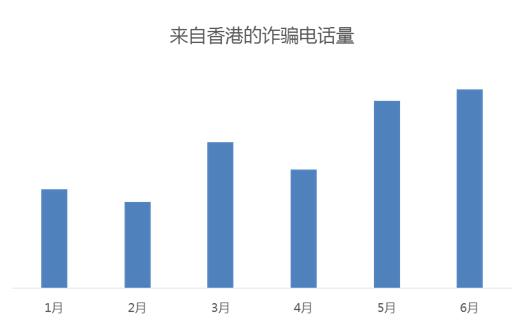

数据显示,钱盾App上半年帮助用户拦截的诈骗电话就来自71个国家和地区,除中国大陆以外,来自香港地区的最多:仅上半年,来自香港的诈骗电话量上涨了101%。

来自香港地区的诈骗电话量上涨明显

国务院联席办钱盾反诈平台联合多地公安反诈中心、蚂蚁金服安全管理部的数据分析还发现,在通讯网络诈骗中,资损程度和受害者年龄呈正相关的关系,年龄越大,其资损的金额就越大。虽然6成诈骗受害者是90后和00后,但是相比较于80,70甚至60后,其资损程度还是相对较低。中老年人一旦被骗,更有可能倾家荡产。

各年龄层的资损情况

“大部分老年人对社会信息摄入较少同时对他人的信任度较高,手段高明的骗子们常常会利用老年人容易紧张等心理特点进行诈骗。公检法诈骗是老年人易中招且资损金额较大的骗局。”沈杰透露。

国务院联席办钱盾反诈平台提醒,通讯网络诈骗手段随着时间的变化也在日益“更新”,甚至出现全球化诈骗的趋势。老百姓除了不断提高自我防范意识外,更有效的办法是借助外力来抵御诈骗。

图8 钱盾App提醒国际电话和网络电话

作为国务院联席办和阿里巴巴联合开发的防骗神器钱盾App,通过这样的数据报告展示了它在反诈防骗领域的能力积累,更通过实时算法,用大数据将通讯网络诈骗防范于未然,针对诈骗电话国际化趋势,钱盾App就率先推出了国际陌生号码的识别提醒功能,帮助用户增强防骗意识。

好文章,需要你的鼓励

让AI看图功能瘦身90%:希腊塞萨洛尼基大学发现图像修复“中奖彩票“神经网络

希腊塞萨洛尼基大学研究团队开发出MIR-L算法,通过"彩票假说"发现大型图像修复网络中的关键子网络。该算法采用迭代剪枝策略,将网络参数减少90%的同时保持甚至提升修复性能。MIR-L能同时处理去雨、去雾、降噪等多种图片问题,为资源受限设备的实时图像处理提供了高效解决方案,具有重要的实用价值和环保意义。

人工智能使用大揭秘:OpenRouter公司百万亿规模数据分析报告

这项由OpenRouter公司团队和Andreessen Horowitz(a16z)投资机构联合开展的研究,于2025年12月发表。

卡内基梅隆大学提出DistCA:让AI训练告别“木桶效应“的神奇技术

卡内基梅隆大学团队提出DistCA技术,通过分离AI模型中的注意力计算解决长文本训练负载不平衡问题。该技术将计算密集的注意力任务独立调度到专门服务器,配合乒乓执行机制隐藏通信开销,在512个GPU的大规模实验中实现35%的训练加速,为高效长文本AI模型训练提供了新方案。

NVIDIA Nemotron 3 系列开放模型: 击穿AI“工程墙”开启“Agentic AI”的“Linux时刻”

W.AWARDS金网奖2026未来商业计划领航秀峰会收官

人工智能使用大揭秘:OpenRouter公司百万亿规模数据分析报告

智能化与全球化并进,IBM中国下一个40年思考

通用汽车推出原生Apple Music应用并支持空间音频

GMV推进卫星导航技术助力自动驾驶运输与物流发展

英伟达考虑增产H200芯片满足中国市场激增需求

IBM推出开源智能体CUGA 任务完成率超五成

OpenAI支持的生物技术公司Chai Discovery获1.3亿美元B轮融资

八问智能时代:西云数据的八个答案

塑造2026年的八大智能手机趋势

AI架构师荣获《时代》杂志年度人物称号